前一段時間一直在研究如何用python抓取搜索引擎結果,在實現的過程中遇到了很多的問題,我把我遇到的問題都記錄下來,希望以后遇到同樣問題的童鞋不要再走彎路。

1. 搜索引擎的選取

選擇一個好的搜索引擎意味著你能夠得到更準確的搜索結果。我用過的搜索引擎有四種:Google、Bing、Baidu、Yahoo!。 作為程序員,我首選Google。但當我看見我最愛的Google返回給我的全是一堆的js代碼,根本沒我想要的搜索結果。于是我轉而投向了Bing的陣營,在用過一段時間后我發現Bing返回的搜索結果對于我的問題來說不太理想。正當我要絕望時,Google拯救了我。原來Google為了照顧那些禁止瀏覽器使用js的用戶,還有另外一種搜索方式,請看下面的搜索URL:

https://www.google.com.hk/search?hl=en&q=hello

hl指定要搜索的語言,q就是你要搜索的關鍵字。 好了,感謝Google,搜索結果頁面包含我要抓取的內容。

PS: 網上很多利用python抓取Google搜索結果還是利用 https://ajax.googleapis.com/ajax/services/search/web... 的方法。需要注意的是這個方法Google已經不再推薦使用了,見 https://developers.google.com/web-search/docs/ 。Google現在提供了Custom Search API, 不過API限制每天100次請求,如果需要更多則只能花錢買。

2. Python抓取并分析網頁

利用Python抓取網頁很方便,不多說,見代碼:

|

1

2

3

4

5

6

7

|

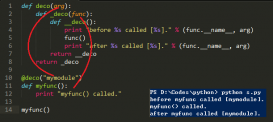

def search(self, queryStr): queryStr = urllib2.quote(queryStr) url = 'https://www.google.com.hk/search?hl=en&q=%s' % queryStr request = urllib2.Request(url) response = urllib2.urlopen(request) html = response.read() results = self.extractSearchResults(html) |

第6行的 html 就是我們抓取的搜索結果頁面源碼。使用過Python的同學會發現,Python同時提供了urllib 和 urllib2兩個模塊,都是和URL請求相關的模塊,不過提供了不同的功能,urllib只可以接收URL,而urllib2可以接受一個Request類的實例來設置URL請求的headers,這意味著你可以偽裝你的user agent 等(下面會用到)。

現在我們已經可以用Python抓取網頁并保存下來,接下來我們就可以從源碼頁面中抽取我們想要的搜索結果。Python提供了htmlparser模塊,不過用起來相對比較麻煩,這里推薦一個很好用的網頁分析包BeautifulSoup,關于BeautifulSoup的用法官網有詳細的介紹,這里我不再多說。

利用上面的代碼,對于少量的查詢還比較OK,但如果要進行上千上萬次的查詢,上面的方法就不再有效了, Google會檢測你請求的來源,如果我們利用機器頻繁爬取Google的搜索結果,不多久就Google會block你的IP,并給你返回503 Error頁面。這不是我們想要的結果,于是我們還要繼續探索

前面提到利用urllib2我們可以設置URL請求的headers, 偽裝我們的user agent。簡單的說,user agent就是客戶端瀏覽器等應用程序使用的一種特殊的網絡協議, 在每次瀏覽器(郵件客戶端/搜索引擎蜘蛛)進行 HTTP 請求時發送到服務器,服務器就知道了用戶是使用什么瀏覽器(郵件客戶端/搜索引擎蜘蛛)來訪問的。 有時候為了達到一些目的,我們不得不去善意的欺騙服務器告訴它我不是在用機器訪問你。

于是,我們的代碼就成了下面這個樣子:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

|

user_agents = ['Mozilla/5.0 (Windows NT 6.1; WOW64; rv:23.0) Gecko/20130406 Firefox/23.0', \ 'Mozilla/5.0 (Windows NT 6.1; WOW64; rv:18.0) Gecko/20100101 Firefox/18.0', \ 'Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US) AppleWebKit/533+ \ (KHTML, like Gecko) Element Browser 5.0', \ 'IBM WebExplorer /v0.94', 'Galaxy/1.0 [en] (Mac OS X 10.5.6; U; en)', \ 'Mozilla/5.0 (compatible; MSIE 10.0; Windows NT 6.1; WOW64; Trident/6.0)', \ 'Opera/9.80 (Windows NT 6.0) Presto/2.12.388 Version/12.14', \ 'Mozilla/5.0 (iPad; CPU OS 6_0 like Mac OS X) AppleWebKit/536.26 (KHTML, like Gecko) \ Version/6.0 Mobile/10A5355d Safari/8536.25', \ 'Mozilla/5.0 (Windows NT 6.1) AppleWebKit/537.36 (KHTML, like Gecko) \ Chrome/28.0.1468.0 Safari/537.36', \ 'Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.0; Trident/5.0; TheWorld)'] def search(self, queryStr): queryStr = urllib2.quote(queryStr) url = 'https://www.google.com.hk/search?hl=en&q=%s' % queryStr request = urllib2.Request(url) index = random.randint(0, 9) user_agent = user_agents[index] request.add_header('User-agent', user_agent) response = urllib2.urlopen(request) html = response.read() results = self.extractSearchResults(html) |

不要被user_agents那個list嚇到,那其實就是10個user agent 字符串,這么做是讓我們偽裝的更好一些,如果你需要更多的user agent 請看這里 UserAgentString。

17-19行表示隨機選擇一個user agent 字符串,然后用request 的add_header方法偽裝一個user agent。

通過偽裝user agent能夠讓我們持續抓取搜索引擎結果,如果這樣還不行,那我建議在每兩次查詢間隨機休眠一段時間,這樣會影響抓取速度,但是能夠讓你更持續的抓取結果,如果你有多個IP,那抓取的速度也就上來了。

github上有本文所有源代碼,需要的同學可從下面的網址下載:

https://github.com/meibenjin/GoogleSearchCrawler